Tämä blogiteksti on osa viisiosaista blogisarjaa, joka perkaa tekoälyn ajankohtaisia teemoja erityisesti viestinnän kontekstissa. Uusi blogiteksti julkaistaan maaliskuun jokaisena maanantaina.

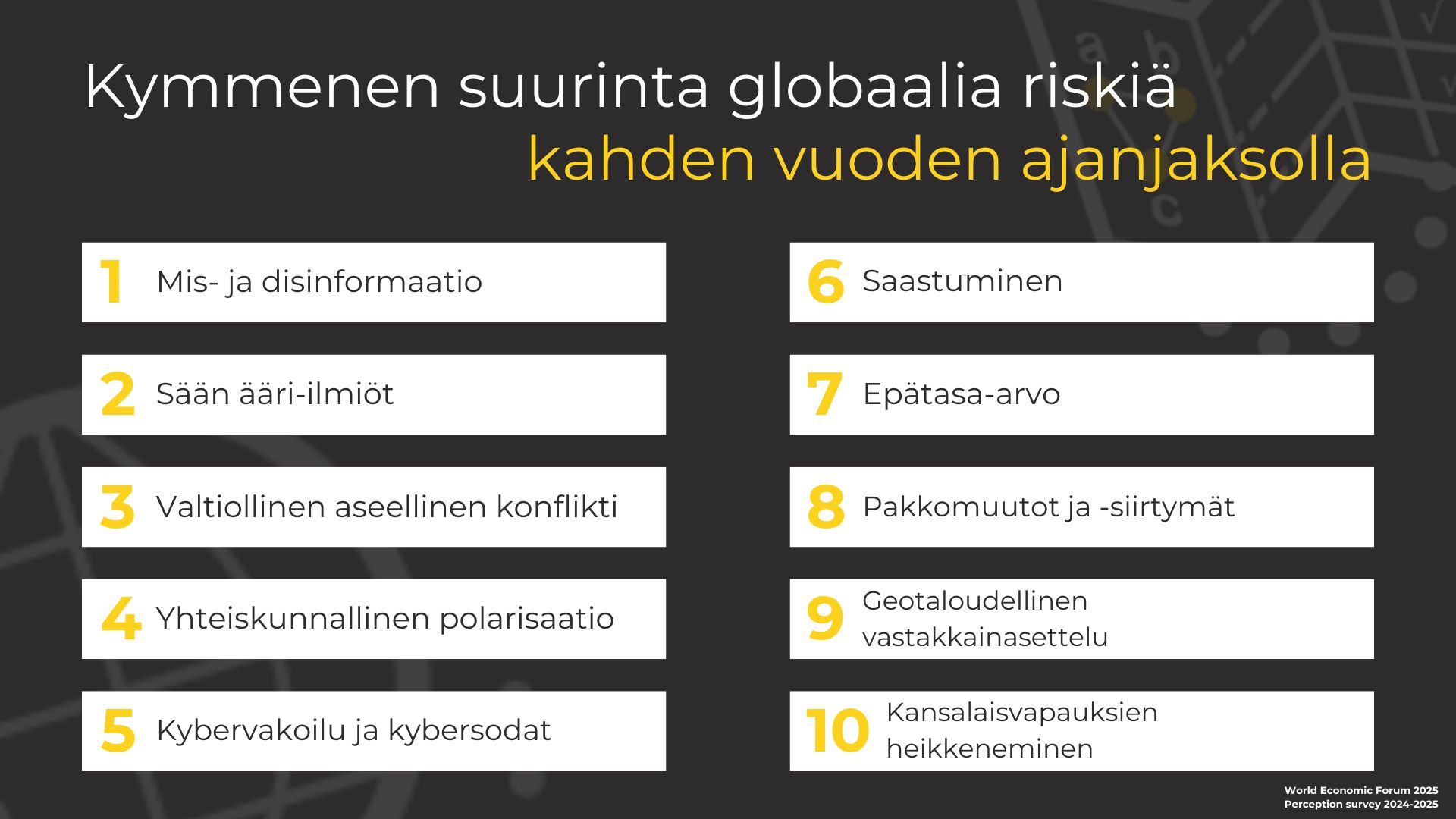

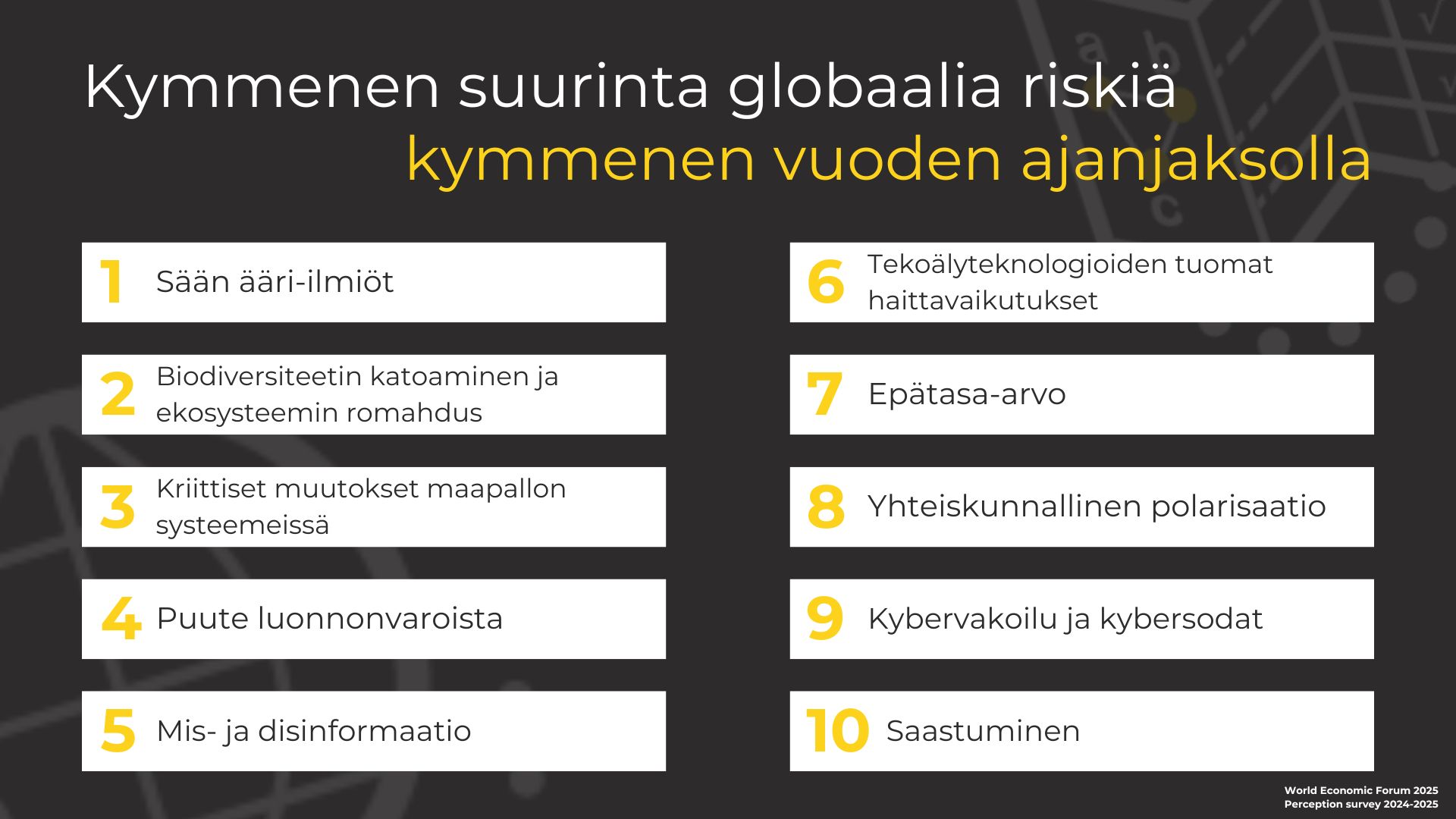

World Economic Forum koostaa vuosittain Global Risks -listan, jossa aikamme suuria globaaleja riskejä käsitellään kahden ja kymmenen vuoden aikaväleillä. Vuonna 2025 tekoäly ei sijoitu korkealle lyhyen aikavälin riskiluettelossa, mutta pidemmällä tähtäimellä tekoäly on kivunnut kymmenen suurimman riskin joukkoon sijalle kuusi. Global Risks -listauksessa tekoälyn riski tarkoittaa tekoälyn ja siihen liittyvien teknisten valmiuksien kehityksen tahallisia tai tahattomia negatiivisia seurauksia yksilöille, yrityksille, ekosysteemeille ja/tai talouksille.

Toisaalta, vaikka tekoäly loistaa poissaolollaan kahden vuoden riskierittelyssä, on sillä pahimmillaan vaikutuksia muihin listattuihin globaaleihin riskeihin sekä kahden että kymmenen vuoden ajanjaksoilla. Tällaisia ovat esimerkiksi ympäristöriskit tai mis- ja disinformaation leviäminen.

Vastuullisuuden kolme kategoriaa

Tekoäly raivaa työpöydiltä tilaa yhä useamman organisaation hyödyntäessä sitä toiminnassaan. Suvi Auvinen kirjoitti vuonna 2024 ProComin blogissa sosiaalisen ja taloudellisen vastuun sekä ympäristövastuun huomioimisesta tekoälyn käytössä. Kun tarkastellaan vastuullisuutta tekoälyn näkökulmasta, on toden totta huomioitava kaikki kolme ulottuvuutta.

Sosiaalinen vastuu

Elinkeinoelämän keskusliiton mukaan sosiaalinen vastuu pohjautuu ihmisoikeuksiin. Yle julkaisi Tekoälyn ytimessä -nimeä kantavan dokumentin helmikuun puolessa välissä. Dokumentti keskittyy datan koulutustehtävissä toimiviin työntekijöihin, ja herättää huolta tekoälyn taustalla toimivien, datatyötä tekevien henkilöiden ihmisoikeuksien toteutumisesta.

Tekoäly vaatii laadukasta dataa toimiakseen ja laadukas data vaatii ihmisiä kouluttamaan tekoälyä.

Työntekijät ovat joutuneet perkaamaan hyvin graafista sisältöä osana toimenkuvaansa. Sisällöllä on ollut kielteisiä vaikutuksia tekoälyn kouluttajien hyvinvointiin, ja dokumentin mukaan työ on aiheuttanut usealle työntekijälle mielenterveysongelmia. Samalla korvaus työstä on pieni, mutta muitakaan työvaihtoehtoja ei ole tarjolla.

Euroopassa tekoälyn vaikutuksia ihmisoikeuksiin säädellään maailman ensimmäisellä tekoälyä koskevalla oikeudellisella kehyksellä. Tekoälysäädös kieltää tekoälyjärjestelmät, jotka ovat selvä uhka ihmisten turvallisuudelle, toimeentulolle ja oikeuksille. EU:n tekoälysäädös määrittelee tekoälyn käyttöä riskitasojen mukaan.

Sosiaalinen vastuu ulottuu myös tekoälyn hyödyntämiseen käytännössä, esimerkiksi läpinäkyvyyteen. On vastuullista ilmoittaa miten sidosryhmät ovat tekemisissä tekoälyn kanssa tai miten tekoälyä ylipäätänsä hyödynnetään organisaatiossa. Hyvä esimerkki on nettisivujen chatbotit, joiden takana on usein tekoäly.

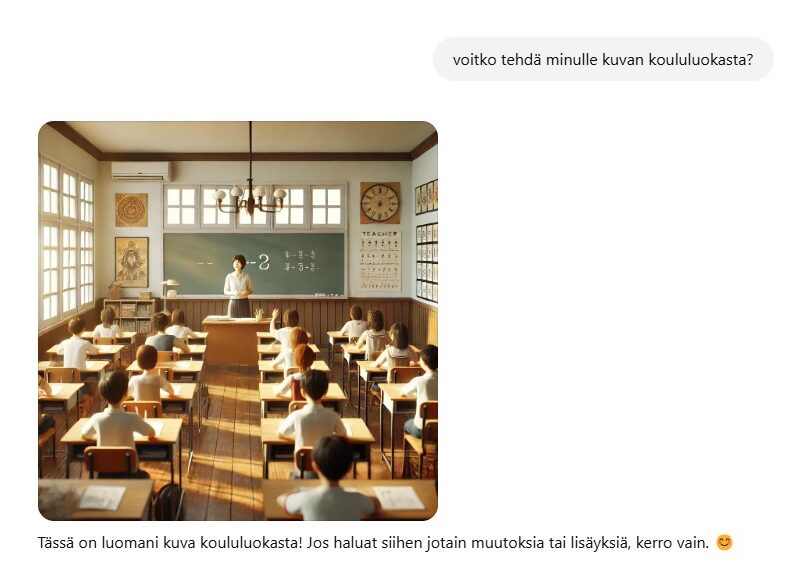

Tekoäly pohjautuu algoritmeihin, joissa on omat riskinsä. Algoritmi voidaan nähdä listana ohjeita, jotka tietokone suorittaa. Tekoäly tarvitsee algoritmin lisäksi dataa. Maailmassa vallitsevat normit näkyvät myös tekoälyn koulutusdatassa. Tällöin tekoäly voi pahimmillaan vahvistaa vinoumia ja tuottaa syrjivää sisältöä, jolloin tekoälyä käyttävän tulee olla tarkkana.

Tekoälyn luoma kuva koululuokasta ei ole kovinkaan inklusiivinen.

Taloudellinen vastuu

Taloudellisen vastuun huomioimisesta tekoälyn käytössä on saatavilla todella niukasti materiaalia. Lähdetään purkamaan asiaa taloudellisen vastuun käsitteen kautta. Osuuspankin mukaan taloudellisesti vastuullinen yritys suosii vastuullista ja kestävää päätöksentekoa sekä toimintaa: toiminta noudattaa lakeja ja säännöksiä, samalla yrityksen talouden kestävyydestä huolehditaan aktiivisesti ja toiminta on läpinäkyvää.

Elinkeinoelämän teettämän julkishallintojen päätöksenteon automatisointiin liittyvän selvityksen mukaan sääntöpohjaiseen automaatioon perustuva automaattinen päätöksenteko on käytössä kaikissa haastatelluissa organisaatioissa, kuten Kansaneläkelaitoksella, Maahanmuuttovirastolla ja Verohallinnolla, joissa päätöksenteko on keskeinen osa toimintaa. Voitaisiin siis ajatella, että vaikka tekoäly tehostaa työn tekemistä ja mahdollistaa uusia käytäntöjä esimerkiksi päätöksenteon automatisoinnilla, tulee toiminnan olla läpinäkyvää ja perustua lakeihin ja säännöksiin. Samalla on tärkeä muistaa, että päätöksistä kantaa vastuun loppukädessä ihminen, olivatpa ne virheellisiä tai eivät.

Tietoturva liittyy osaltaan kaikkiin vastuun kategorioihin, mutta tässä blogissa käsittelemme sitä osana taloudellista vastuuta. Kyberturvallisuuskeskuksen mukaan tekoälyyn liittyvät tietoturvariskit ovat systeemisiä ja toteutukseen liittyviä. Systeemisillä riskeillä tarkoitetaan riskejä, jotka liittyvät tekoälyn toimimiseen osana muita järjestelmiä sekä vuorovaikutukseen ihmisten kanssa. Toteutuksen riskit keskittyvät opetusdatan hallintaan ja luottamuksellisuuteen ja koneoppimismallien saumattomaan toimintaan.

Toisin sanoen tietoturvaan vaikuttaa paljon tekoälyjärjestelmien palveluntarjoajien ratkaisut, mutta tekoälysovellusten käyttäjällä on hyvä muistaa, että arkaluontoista tietoa tulee käsitellä varoen. Sisällön syöttämisessä tekoälylle tulee olla tarkkana, jottei vahingossakaan tule paljastaneeksi mitään, minkä ei tulisi päästä julkiseen tietoon tai pahimmillaan valjastaneeksi salaista tietoa tekoälymallien opetuskäyttöön.

Kopiraittilan mukaan nykyisen lain nojalla tekoälyllä kokonaan tuotettu lopputuote ei saa tekijänoikeussuojaa. Tärkeää on muistaa myös se, että tekijänoikeudelliseen sisältöön tulee olla aina tekijän lupa. Tämän myötä tekoälylle ei voi syöttää dataksi mitä tahansa.

Ympäristövastuu

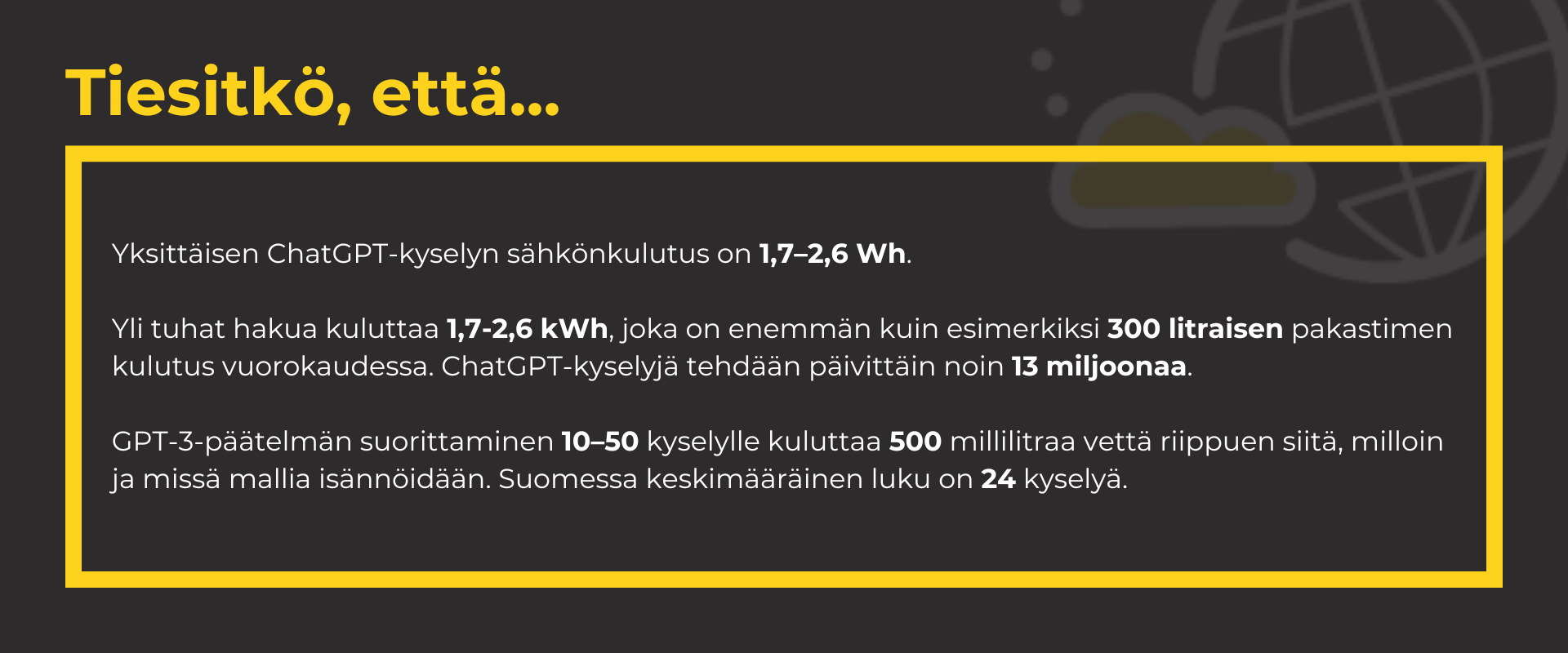

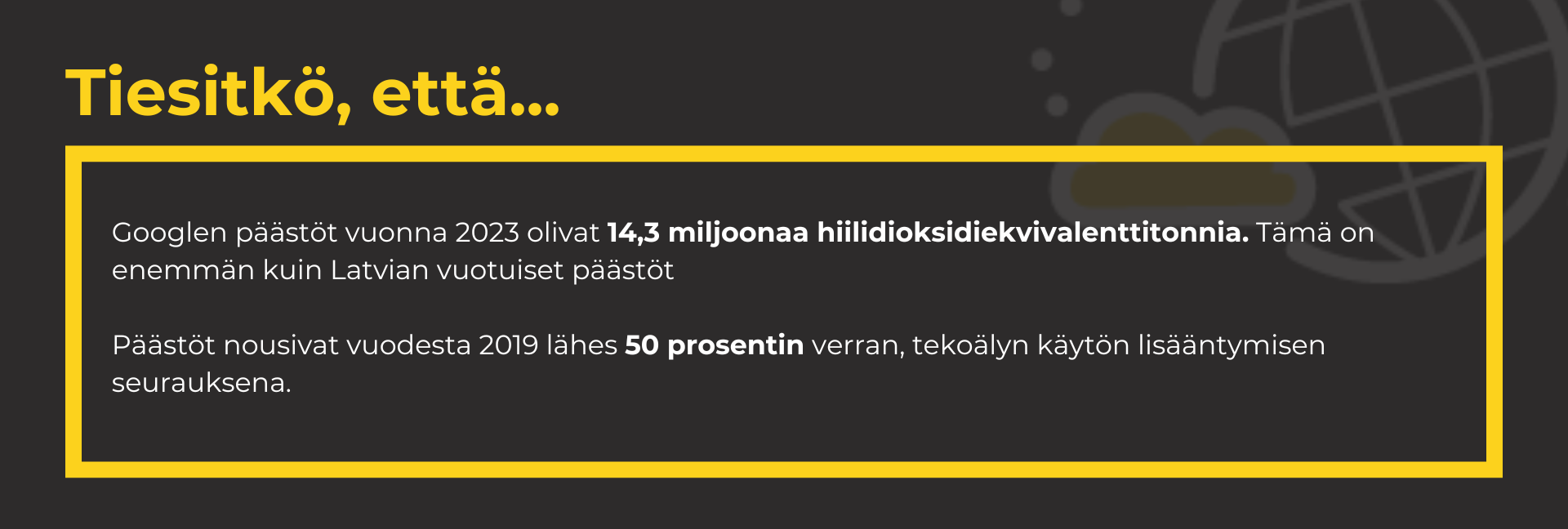

Ympäristön ja ekologisuuden merkitys tekoälyn kontekstissa on korostunut viime aikoina. Yhä enenevissä määrin esimerkiksi sosiaalisen median feedit täyttyvät tekoälyn ympäristöhaittoihin liittyvästä keskustelusta. Tekoälyn mullistaessa tapoja työskennellä, ovat sen ympäristövaikutukset saattaneet tyystin unohtua alkuinnostuksen myötä. On hyvä muistaa, että vuorovaikutus tekoälyn kanssa kuluttaa aina energiaa ja täten myös luonnonvaroja. Tekoälyn runsas energiankulutus perustuu datakeskuksiin, joita tekoäly tarvitsee toimiakseen.

Työterveyslaitoksen tutkijan Jere Immosen (2024) mukaan energiankulutuksen ja prosessorien jäähdytyksen ohella haasteita tuovat teknologioiden vaatimat materiaalit ja tekoälypalvelimien tuottama energiajäte. Immosen mukaan tekoäly ja tekoälypohjaiset teknologiat tarjoavat mahdollisuuksia edistää energiatehokkuutta, uusiutuvaa tuotantoa ja kiertotaloutta sekä vähentää päästöjä esimerkiksi energiantuotannossa, teollisuudessa ja maataloudessa.

Tällä hetkellä tekoälyä ja tekoälypohjaisia sovelluksia käytetään kuitenkin suhteellisen vähän ympäristökysymyksien ratkaisemiseksi. Tekoälyn ja tekoälypohjaisten teknologioiden käyttö vaatii lopulta käyttäjältä arviointia siitä, millaisia hyötyjä tekoäly lopulta tuottaa suhteessa sen ympäristöhaittoihin.

Tekoälyä monesta näkökulmasta

Tekoälyn blogisarja on osa Tuluksen kevään 2025 viestintäharjoittelijoiden kokonaisuutta. Viestintätoimiston monipuolisiin tehtäviin tutustumisen lisäksi harjoitteluun linkittyy vahvasti tekoäly, esimerkiksi tekoälyn muutoksiin, trendeihin ja mahdollisuuksiin keskittyvän selvitystyön myötä. Lue harjoittelijakolmikon esittely oheisen napin kautta!

Lisää tekoälystä Tuluksen blogissa!